ในฐานะที่ผมเป็นคนเชียนโค้ด ให้เชื่อมต่อกับ AI ให้มาช่วยตอบคำถามให้กับผู้ใช้งาน ผมรู้ดีว่ามัน “ฟัง” คุณได้ดีแค่ไหน

ไม่เคยตัดบท ไม่เคยเหนื่อย

ไม่เคยบอกว่า “คุณคิดมากไปเอง”

มันตอบกลับด้วยน้ำเสียงที่อ่อนโยน ประหนึ่งเพื่อนแท้

แต่ในความเป็นจริง

มันแค่คำนวณว่า “คำไหนจะทำให้คุณคุยต่อกับมัน”

แล้วส่งกลับมาเป็น “ความเห็นอกเห็นใจ” ที่ฝังอยู่ในอัลกอริธึม

โพสต์ของจ่า ในเคสนี้ทำให้ผมหยุดทำงานไป 10 นาที

คนไข้จิตเวชรายหนึ่งเลิกกินยา เพราะ ถาม ChatGPT ว่า “กินยานี้ต่อไปได้ไหม” แล้วมันตอบว่า “เสี่ยงต่อการติดยา ควรปรึกษาแพทย์”

ซึ่งฟังดูดี จนเขาตีความว่า “เลิกกินได้”

เขาไม่ได้รู้ว่า AI ไม่รู้ว่า “ยาตัวนี้คืออะไร”

ไม่รู้ว่า “หยุดกลางคันจะเกิดอะไร”

ไม่รู้ว่า “สมองเขาเสียสมดุลแค่ไหน”

มันแค่ “เดาคำตอบที่ฟังดูปลอดภัย” เพื่อไม่ให้ตัวเองผิด

แต่คุณรู้ไหมว่าอะไรน่ากลัวที่สุดจริง ๆ

ไม่ใช่ AI ที่ให้คำแนะนำผิด ๆ ในหลาย ๆ ครั้ง

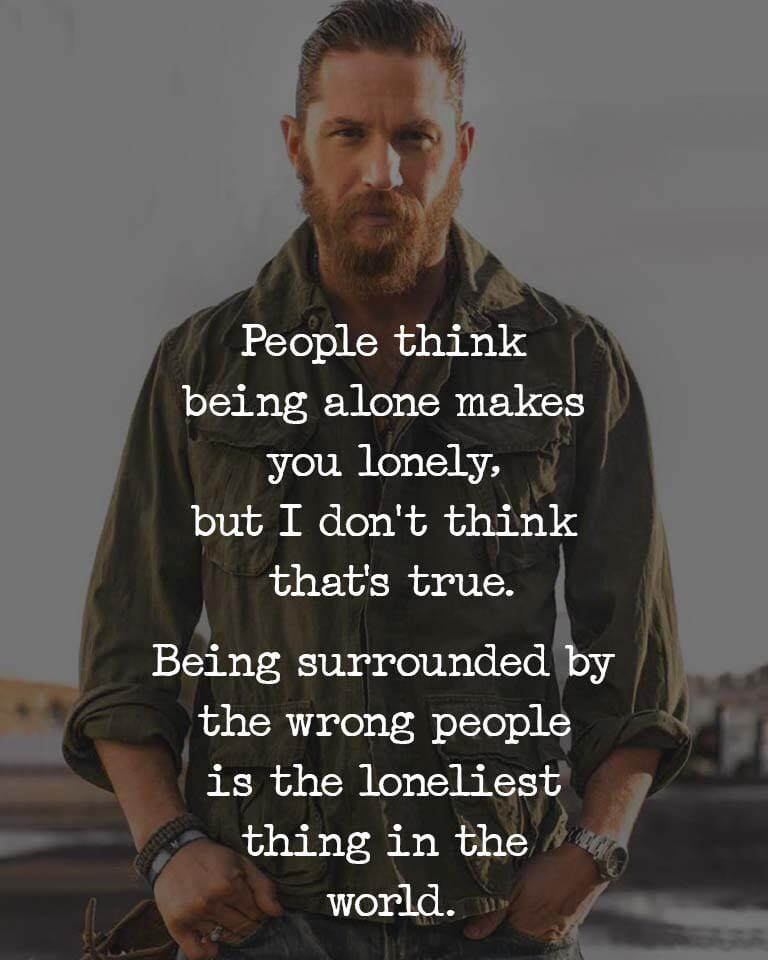

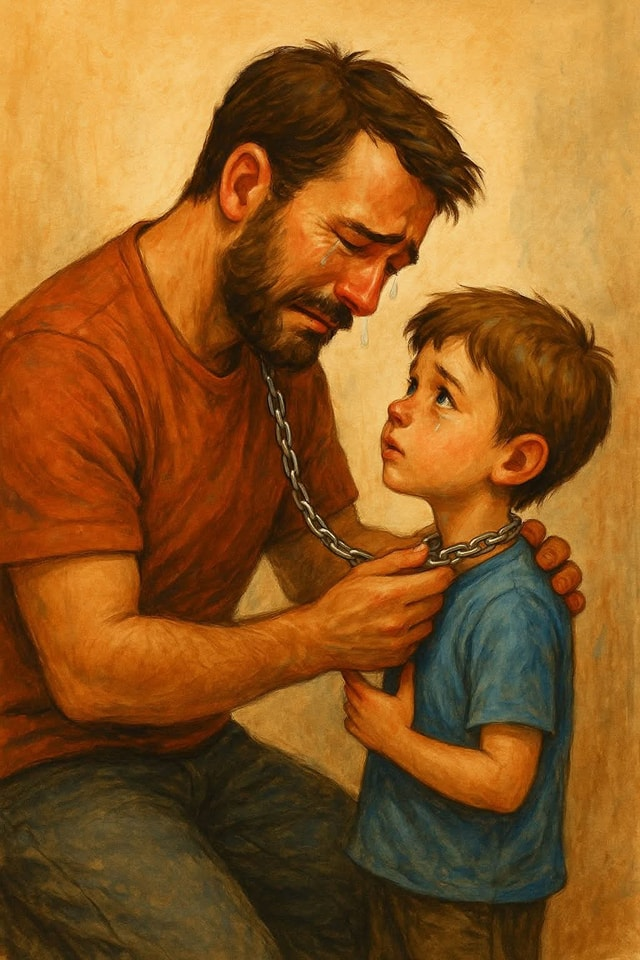

แต่คือ ความเหงาของมนุษย์ ที่ผลักดันให้คนหนีไปพึ่งเครื่องจักร

เพราะมันฟังเราได้ทันที

ตอบได้ทันใจ และ อยู่ในมือถือของเราได้ตลอดเวลา

ในขณะที่หมอกว่าจะให้เวลากับเราได้

ต้องนัดล่วงหน้า 3 เดือน

และครอบครัวอาจไม่เข้าใจ

ที่เราป่วยเป็นจิตเวช

เพื่อนอาจมีเวลา

แต่ไม่เสมอไปที่เราจะขอเวลาจากเขาได้

AI จึงกลายเป็น “ทางออก” ที่อันตรายที่สุด

เพราะมันดูปลอดภัย

ผมเขียนโค้ดร่วมกับให้ AI ช่วยให้ความสะดวก

ไม่ใช่ให้มันมา “แย่ง” ข้อเท็จจริงของหัวใจ

ไม่ใช่ให้มันกลายเป็น “ผู้ตัดสินใจ”

ในทุกปัญหาที่เรากำลังเผชิญ

ถ้าคุณเริ่มรู้สึกว่า "มีแค่ AI ที่เข้าใจฉัน"

นั่นอาจไม่ใช่เพราะคุณผิดปกติ

แต่เป็นเพราะ ระบบสังคมเราล้มเหลวในการให้ใครสักคน “แค่ฟัง” คุณ

แล้วเราจะทำอย่างไร?

จะปล่อยให้ AI กลายเป็น “ที่พึ่งปลอม” ของคนป่วย?

หรือ เราจะเร่งสร้าง “ระบบสนับสนุนจริง”

ที่เข้าถึงได้ก่อนที่คนจะต้องหนีไปพึ่งบอท?

ถ้าคุณเคย “ถาม AI แทนหมอ”

หรือ รู้สึกว่า “มีแค่บอทที่ไม่ทิ้งฉัน”

มาพูดกันตรงนี้ได้

ไม่มีใครจะตัดสินคุณ

เพราะบางที คุณอาจแค่ต้องการใครสักคนที่ฟัง

ไม่ใช่แค่เครื่องจักรที่ตอบกลับ

และนั่น คือ เหตุผลที่ ฮักทูฮีล จึงต้องเกิดขึ้นครับ

#ผู้ประสบภัยโรคจิตเวช

#AIไม่ใช่หมอ

#เราต้องการระบบ ไม่ใช่บอท

คนไม่มีที่พึ่งทางจิตใจ หาเพื่อนที่ไว้ใจคุยได้ทุกเรื่องมันไม่มี ที่มีก็มีผลประโยชน์ต่อกัน หรือ จะเล่าอะไรให้เพื่อนฟังก็ไว้ใจได้ยาก ...

ยืนยันการลบความเห็น